引言

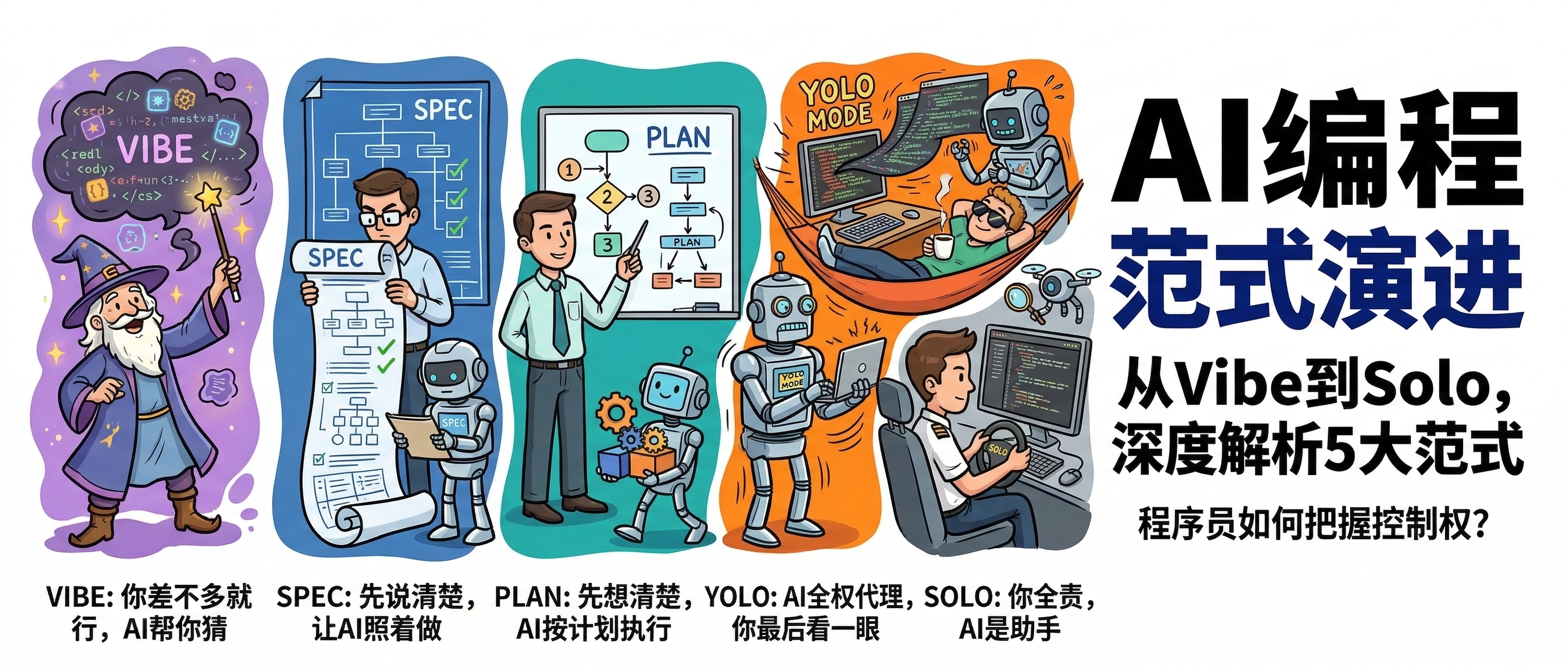

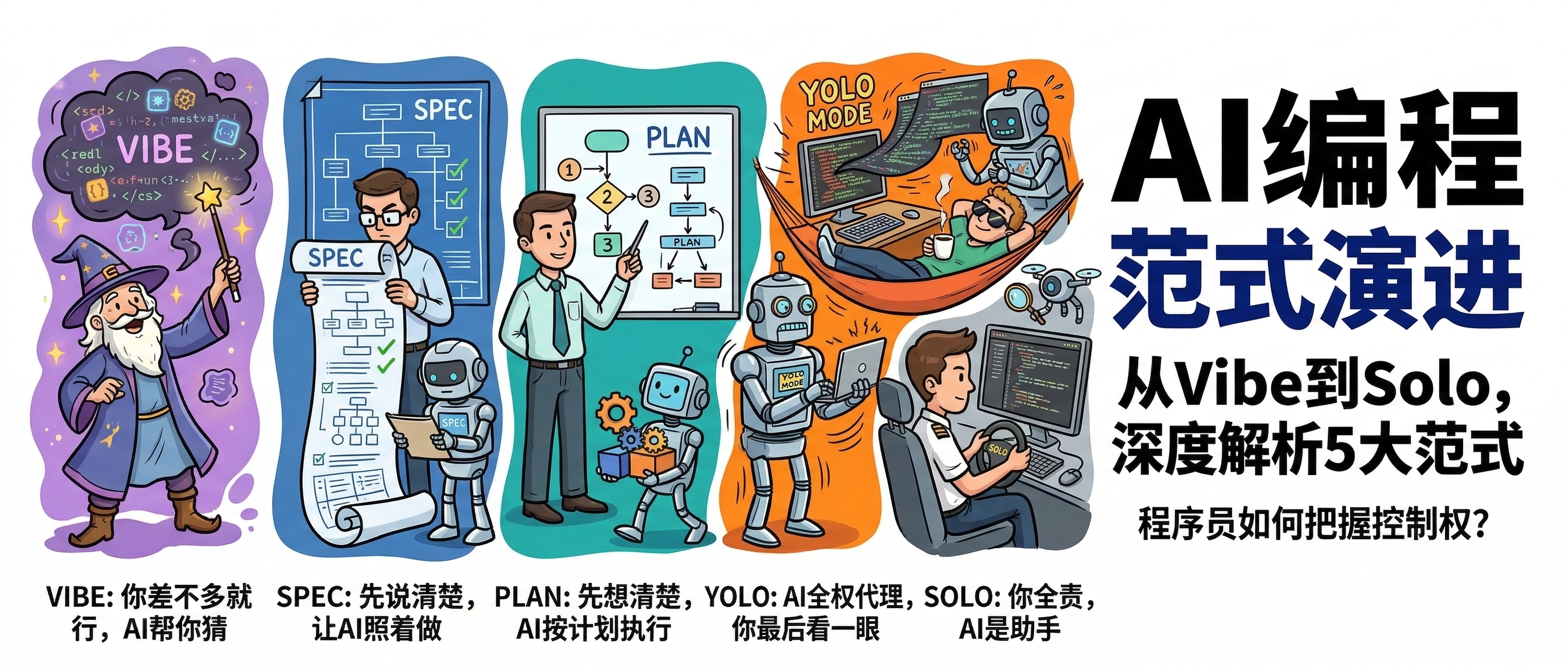

2021年GitHub Copilot发布后,AI编程逐渐从实验性工具走向主流。在这LLM大火的这几年,AI Coding的出现,在软件开发领域又掀起了一场AI编程的进化,在这过程中我们从最初的Vibe coding,到后面的Spec Coding,再到各工具厂商提出的YOLO、SOLO等模式,开发者在软件工程中的作用产生了微妙又巨大的变化。

这些”范式”并不是学术界严格定义的标准,而是实践中总结出来的称呼。比如Andrej Karpathy的”Vibe Coding”,GitHub的”Spec-Driven Development”,Cursor的”YOLO Mode”,还有字节跳动的”Solo Mode”——本质上都是各家对”怎么用好AI写代码”这个问题的不同答案。

但如果我们仔细观察,会发现这些模式背后有一个共同的核心问题:如何在享受AI带来的效率提升的同时,保持对代码的控制?

阅读全文 »

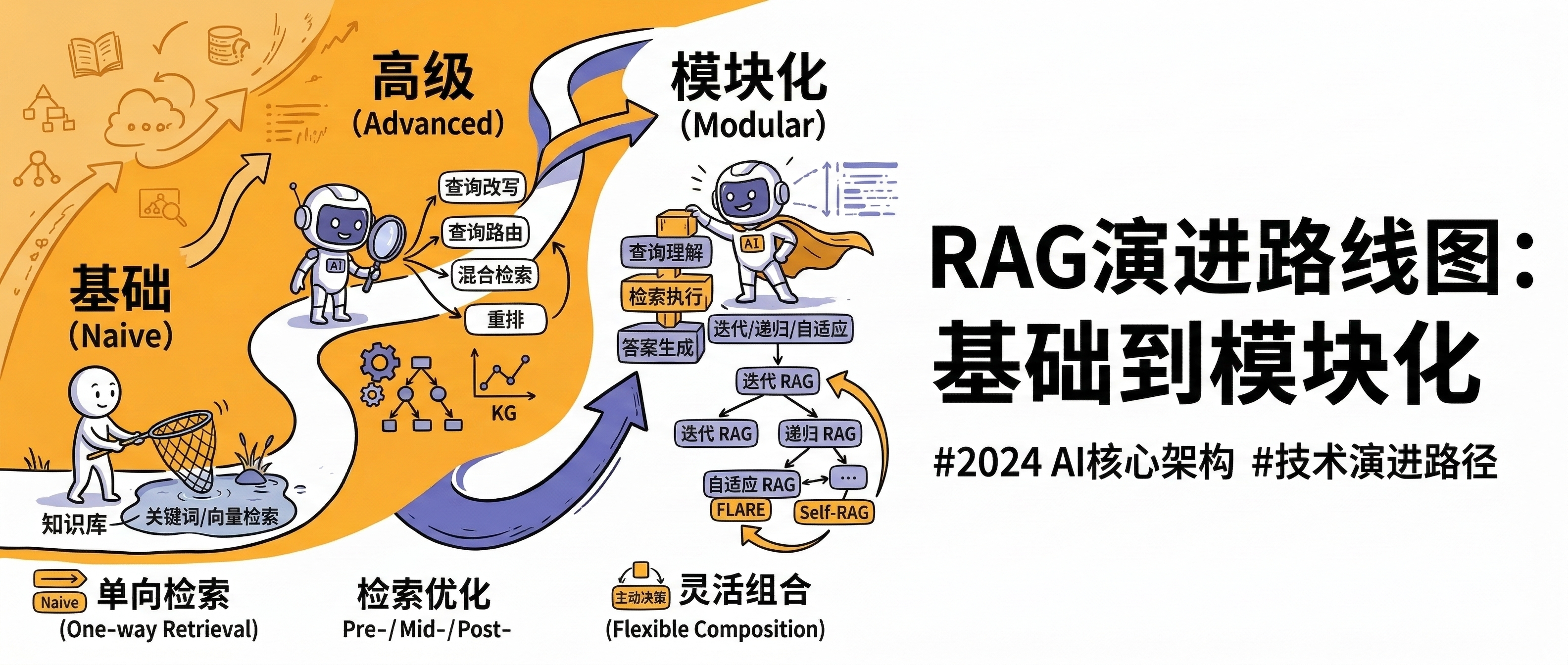

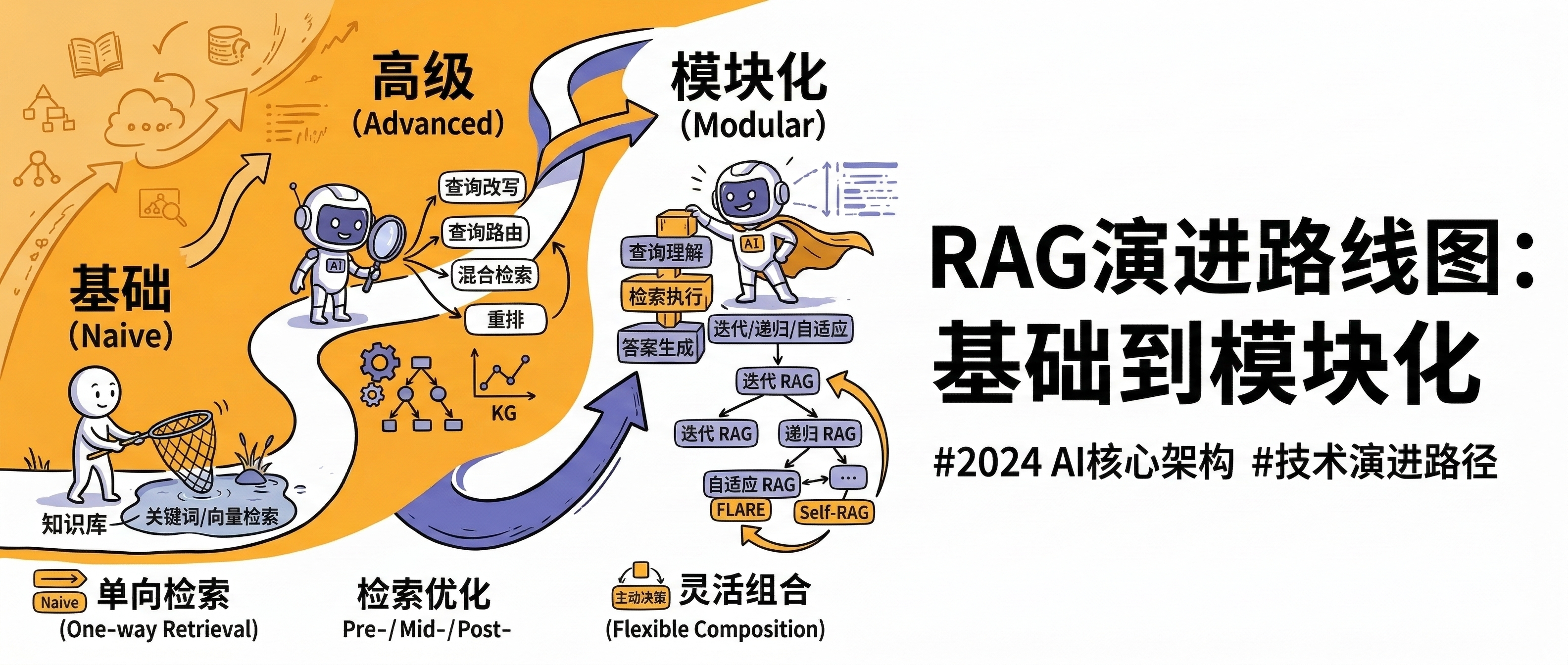

2024年,RAG(Retrieval-Augmented Generation,检索增强生成)技术已经成为AI应用的核心架构之一。从最初的Naive RAG到Advanced RAG,再到如今的Modular RAG,这条技术路线图清晰地展示了RAG技术的演进路径。

阅读全文 »

如果说 2023 年是 AutoGPT 引爆 Agent 概念的一年,那么 2024 年则是这些概念逐渐沉淀、范式逐渐清晰的一年。

在实践中,三种经典范式逐渐脱颖而出:ReAct、Plan-and-Solve 和 Reflection。

它们不是相互替代的关系,而是可以组合在一起,构建出强大的智能体系统。

阅读全文 »

互联网时代,网站是核心载体;移动互联网时代,App 占据了人们的注意力中心。那么,智能时代呢?

一个大胆的预测:Agent 可能成为智能时代的核心载体。

阅读全文 »

ChatGPT 的出现让我们看到了 AI 对话的强大能力,但你有没有想过:如果 AI 不仅能回答问题,还能自主规划、执行任务,会是什么样子?

这就是 AutoGPT 正在做的事情——让 AI 从”被动回答”进化到”主动行动”。

阅读全文 »